Explainable AI Interface

Zwiększ zaufanie do swoich modeli AI i spełnij wymogi AI Act 2026.

Projektujemy interfejsy, które tłumaczą decyzje modeli AI — w sposób zrozumiały dla użytkowników i regulatorów.

Dlaczego Explainability w AI to Twoja przewaga

W dużych organizacjach decyzje podejmowane przy wsparciu AI muszą być uzasadnione i audytowalne. Explainable AI Interface dostarcza narzędzi, które pozwalają menedżerom, specjalistom i klientom rozumieć rezultaty działania modeli AI.

Dlaczego Explainability ma znaczenie teraz

(AI Act 2026)

W 2026 r. każdy system wysokiego ryzyka AI będzie musiał spełnić wymogi przejrzystości i nadzoru człowieka. Firmy, które przygotują się wcześniej, unikną kar i zyskają zaufanie klientów.

“Users must be able to understand the logic and limitations of AI systems they interact with. Explainability is a legal obligation for high-risk applications.”

EU AI Act, Recital 47, 2026

Dlatego projektujemy warstwy wyjaśnialności, które w prosty sposób pokazują logikę modelu.

Moje

Rozwiązania dla

środowisk AI

Explainable AI Interface to projektowanie interfejsów i elementów UX, które sprawiają, że decyzje modeli AI stają się zrozumiałe, transparentne i audytowalne.

W ramach usługi tworzymy przejrzyste, wyjaśnialne warstwy interakcji — np. dashboardy pokazujące, dlaczego algorytm podjął daną decyzję, jakie dane miały na nią wpływ i z jaką pewnością rekomenduje wynik. Explainable AI Interface obejmuje m.in. wizualizacje czynników wpływu, moduły „zapytaj AI, dlaczego”, komunikaty ostrzegawcze o niepewności oraz mechanizmy kontroli człowieka nad decyzją AI. Dzięki temu organizacje mogą kalibrować zaufanie do AI i przygotować się do wymogów AI Act 2026.

- Ocena, czy obecny interfejs komunikuje: zaufanie / confidence, źródła danych,ograniczenia i błędy modelu, możliwości ingerencji człowieka.

- Porównanie z wymogami przejrzystości określonymi w AI Act (Art. 13, 52).

- Raport z rekomendacjami UX i compliance.

- Mapa przepływów poznawczych (user → AI → feedback).

- Projekt makiet interfejsów: Confidence Bar (poziom pewności predykcji), Decision Factors Panel (kluczowe cechy wpływające na decyzję), Model Card Modal (transparentność modelu), Feedback Loop UI (dla użytkownika końcowego).

- Dokumentacja UX / UI dla wdrożenia.

- Projektujemy interfejsy zgodne z zasadami AI Act (Art. 13 – przejrzystość, Art. 14 – nadzór człowieka).

- Testy zrozumiałości interfejsu (XAI comprehension testing).

- Analiza reakcji użytkowników na niepewność i błędy modelu.

- Iteracja projektu na podstawie wyników jakościowych.

- Testy zrozumiałości decyzji AI (Explainability Testing) – element audytu UX zgodnego z AI Act.

- Warsztaty “Bridging UX and Model Logic”

- Konsultacje przy wdrażaniu API / interpretability layer (SHAP, LIME, ELI5, itp.)

- Definicja interfejsu danych i modelu w języku UX (dla dokumentacji produktu).

- Nasze działania wspierają proces zgodności z AI Act, nie stanowią formalnej oceny ani certyfikacji.

- *Raport z audytu XAI (PDF)

- Interaktywne makiety interfejsów (Figma / Webflow)

- Komplet rekomendacji UX & compliance (do wdrożenia przez zespół produktowy)

- 6-godzinny warsztat strategiczny dla firm wdrażających lub rozwijających produkty AI – obejmuje mapę ryzyk, omówienie kluczowych wymogów AI Act oraz rekomendacje działań „compliance-by-design”

- Interaktywne makiety interfejsów (Figma / Webflow)

- Komplet rekomendacji UX & compliance (do wdrożenia przez zespół produktowy)

Usługi mają charakter doradczy i projektowy. Nie stanowią formalnej certyfikacji zgodności systemów AI w rozumieniu rozporządzenia (UE) 2024/1689.

Warstwa interfejsu, która tłumaczy decyzje modeli i wizualizuje logikę działania AI. Pomaga firmom spełnić wymóg przejrzystości i wyjaśnialności (art. 13), jednocześnie zwiększając zaufanie użytkowników do systemu.

Twoje AI staje się zrozumiałe, audytowalne i gotowe na inspekcję regulacyjną.

91% firm ma wątpliwości, czy są "przygotowane" na bezpieczne i odpowiedzialne AI. 40% respondentów wskazało brak wyjaśnialności jako kluczowe ryzyko, ale tylko 17% aktywnie to ryzyko ogranicza.

Dopasowanie do potrzeb Enterprise

W organizacjach, w których decyzje oparte na AI mają realny wpływ na ludzi i finanse, kluczowe jest ich uzasadnienie, audytowalność i zrozumiałość. Explainable AI Interface dostarcza narzędzi, które pozwalają menedżerom, analitykom i klientom weryfikować logikę modeli, tłumaczyć wyniki i budować zaufanie do decyzji wspieranych przez AI.

Przykłady zastosowań

Zobacz, jak explainability przekłada się na realne decyzje w Twojej branży.

Interfejs dla analityków finansowych prezentujący główne czynniki wpływające na decyzję AI przy ocenie kredytowej. System wskazuje, że kluczowe były „historia spłat" i „dochód w ostatnich 12 miesiącach", pokazując ich wagę.

System AI wspierający diagnozę dostarcza lekarzowi wyjaśnienie rekomendacji. Obok wyniku modelu pojawia się heatmap wskazujący obszary obrazu RTG, które wpłynęły na decyzję, oraz statystyki pewności.

System AI wspierający kontrolę jakości analizuje zdjęcia z linii produkcyjnej i oznacza potencjalne defekty. Interfejs explainability pokazuje, które fragmenty obrazu wpłynęły na ocenę, pozwalając inżynierom szybko zweryfikować decyzję modelu i zredukować liczbę błędnych odrzutów.

Model AI wspierający przyznawanie dotacji lub świadczeń społecznych generuje rekomendacje decyzji wraz z uzasadnieniem. Interfejs Explainable AI prezentuje czynniki, które miały największy wpływ na ocenę wniosku, zapewniając pełną przejrzystość procesu i zgodność z zasadą human oversight wymaganą przez AI Act.

Doświadczenie zawodowe

End-to-end design from UX research to UI and Webflow—backed by 17+ years in top companies.

Let's talk →

Head of UX · CloudFerro S.A.

As Head of UX at CloudFerro, I lead end-to-end user experience for our cloud-based products.

- Strategy & Vision: Define UX roadmap aligned with business goals, onboarding stakeholders from sales to engineering

- Team Leadership: Mentor and coordinate a distributed team of UX/UI designers and researchers

- Data-Driven Design: Implement usability testing and analytics to continuously optimize dashboards and workflows

- Cross-Functional Collaboration: Partner with product managers and developers to ensure seamless, on-time delivery

Founder · Stealth Startup

Building a niche SaaS tool from the ground up, focused on AI and Data.

- Product Ideation: Conducted market research and validated the MVP through hands-on user interviews

- Full-Stack Design: Crafted wireframes, high-fidelity UI, and design system in Figma

- Rapid Prototyping: Launched clickable prototypes to secure early pilot customers

- Brand & Go-to-Market: Developed logo, website (Webflow), and positioning that resonated with beta users

Chief Design Officer · Stella Technologies Group LLC

Overseeing all design functions for a fast-growing API integration platform.

- Design Management: Built and scaled the first in-house design team, established hiring processes

- Brand Leadership: Revamped Stella’s visual identity and messaging for enterprise audiences

- Systematization: Introduced a modular design system to ensure consistency across web, mobile, and docs

- Stakeholder Alignment: Regularly present UX roadmaps and ROI forecasts to C-suite

Head of Product Design · SALESmanago

Led product UX/UI for one of Europe’s largest marketing-automation platforms.

- Team & Process: Managed 4 designers and 2 researchers in a hybrid setup (Cracow + remote)

- User Research: Ran regular persona workshops, uncovering insights that boosted feature adoption by 45%

- Strategic Initiatives: Launched a redesigned analytics dashboard, driving a 200% increase in customer-reported ROI

- Design System: Championed and rolled out a scalable component library in Figma and Storybook

.png)

Head of Product Design · Beans Marketplace

Delivered a full UI/UX overhaul for a B2B coffee-trading platform under tight deadlines.

- End-to-End Execution: Owned research, wireframing, visual design, and developer hand-off

- Brand Alignment: Ensured every interface reflected Beans’ mission of seamless B2B commerce

- Timely Delivery: Met all sprint milestones, enabling a successful public beta launch

- Outcome: Positive user feedback on navigation flow and purchase funnel efficiency

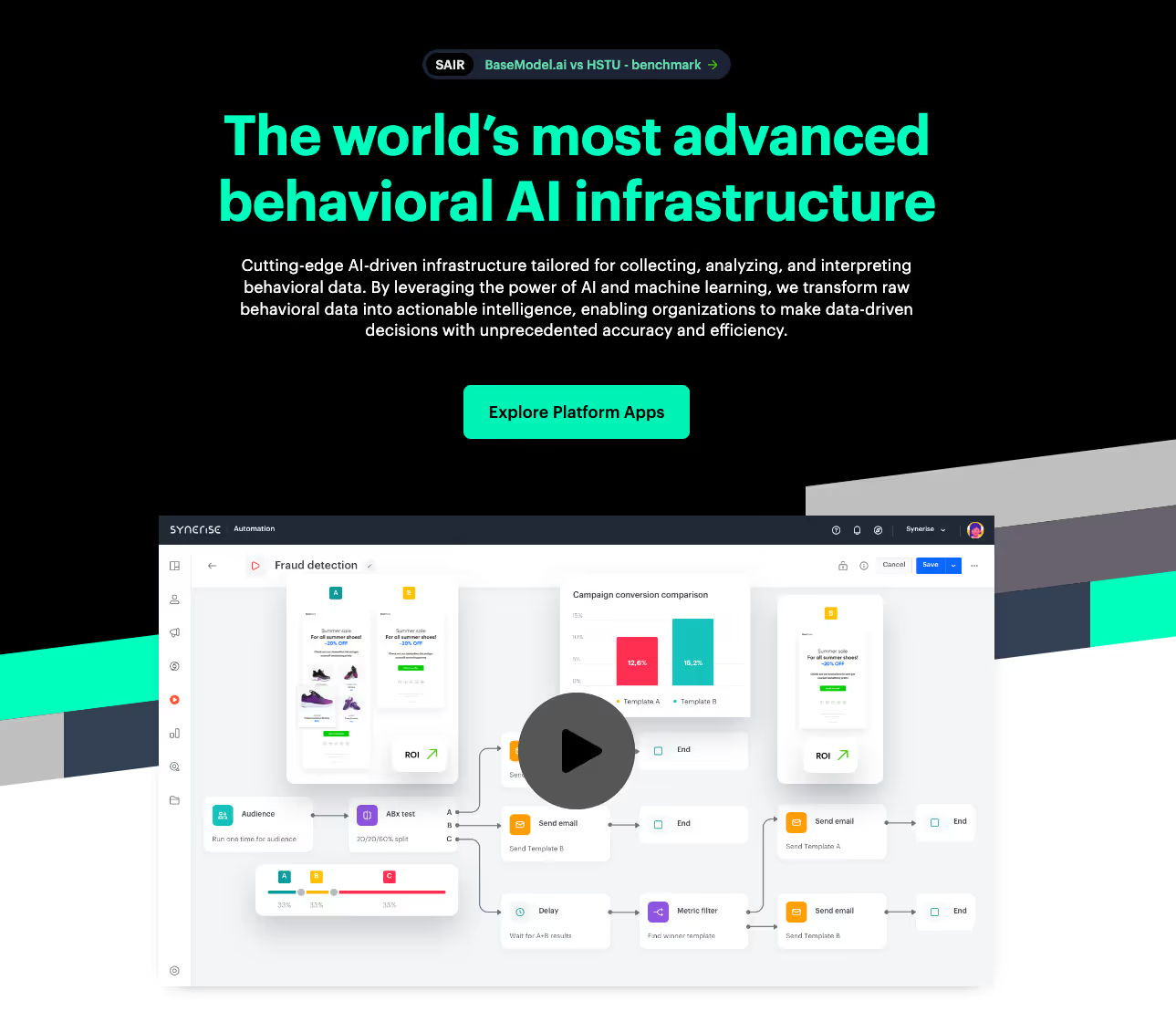

Senior Product Designer & Design System Product Owner · Synerise

At Synerise a Polish AI-driven growth ecosystem I combined hands-on product design with end-to-end ownership of the company’s first design system:

- Design System Leadership: Spearheaded creation and rollout of a modular UI library in Storybook, crafting 300+ components with full documentation to ensure consistency across web and mobile.

- Feature & Interaction Design: Designed and prototyped core features for Synerise’s real-time interaction management platform, improving usability and reducing user errors by an estimated 25%.

- Cross-Functional Partnership: Worked side-by-side with front-end engineers, product managers, and data scientists to integrate design assets directly into React code, cutting hand-off time by 20%.

- Team Mentorship & Processes: Established UX/UI best practices, led weekly design reviews, and mentored junior designers—fostering a culture of user-centered thinking and rapid iteration.

- Impact & Outcomes: Accelerated design-to-development cycles by over 30%, drove internal adoption of the new design system, and supported Synerise’s growth from startup to market leader in its segment.

Zacznij proces explainability AI w swojej organizacji.

Odezwiemy się w 24h z propozycją krótkiego calla diagnostycznego.

Skontaktuj się, aby omówić projekt AI dla Twojej organizacji.